La división de investigación de IA de Microsoft filtró accidentalmente 38 terabytes de datos confidenciales a partir de julio de 2020 mientras contribuía con modelos de aprendizaje de IA de código abierto a un repositorio público de GitHub.

Casi tres años después, esto fue descubierto por la empresa de seguridad en la nube Wiz, cuyos investigadores de seguridad descubrieron que un empleado de Microsoft compartió sin darse cuenta la URL de un almacenamiento Azure Blob mal configurado y que contenía la información filtrada.

Microsoft vinculó esta exposición de los datos al uso de un token de firma de acceso compartido (Shared Access Signature - SAS) excesivamente permisivo, que permitía un control total sobre los archivos compartidos. Esta característica de Azure permite compartir datos de una manera que los investigadores de Wiz describen como difícil de monitorear y revocar.

Cuando se usan correctamente, los tokens de firma de acceso compartido (SAS) ofrecen un medio seguro para otorgar acceso delegado a los recursos dentro de su cuenta de almacenamiento. Esto incluye un control preciso sobre el acceso a los datos del cliente, especificando los recursos con los que puede interactuar, definiendo sus permisos con respecto a estos recursos y determinando la duración de la validez del token SAS.

"Debido a la falta de monitoreo y gobernanza, los tokens SAS representan un riesgo para la seguridad y su uso debe ser lo más limitado posible. Estos tokens son muy difíciles de rastrear, ya que Microsoft no proporciona una forma centralizada de administrarlos dentro del portal Azure", advirtió Wiz hoy.

"Además, estos tokens se pueden configurar para que duren efectivamente para siempre, sin límite superior en su tiempo de caducidad. Por lo tanto, usar tokens Account SAS para compartir externamente no es seguro y debe evitarse".

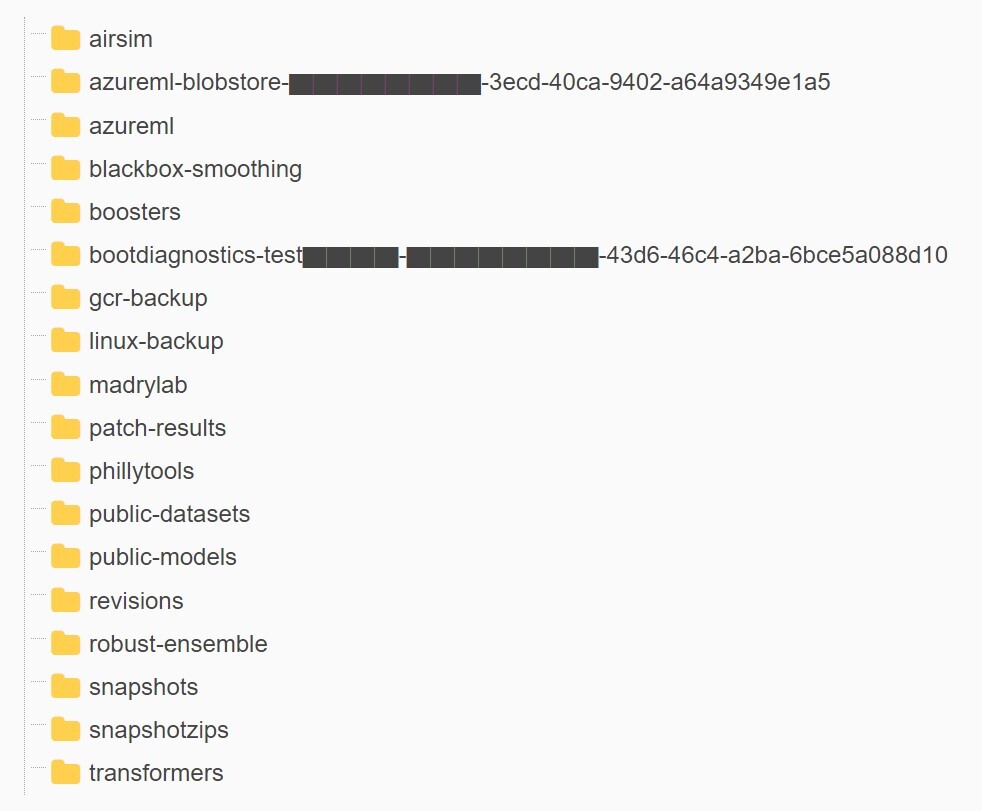

38 TB de datos privados expuestos a través del almacenamiento de Azure

El equipo de investigación de Wiz descubrió que, además de los modelos de código abierto, la cuenta de almacenamiento interno también permitía sin darse cuenta el acceso a 38 TB de datos privados adicionales.

Los datos expuestos incluían copias de seguridad de información personal de empleados de Microsoft, incluidas contraseñas de servicios de Microsoft, claves secretas y un archivo de más de 30.000 mensajes internos de Microsoft Teams procedentes de 359 empleados de Microsoft.

En un aviso del lunes del equipo del Centro de respuesta de seguridad de Microsoft (MSRC), Microsoft dijo que no se expusieron datos de clientes y que ningún otro servicio interno corría peligro debido a este incidente.

Wiz informó el incidente a MSRC el 22 de junio de 2023, que revocó el token SAS para bloquear todo acceso externo a la cuenta de almacenamiento de Azure, mitigando el problema el 24 de junio de 2023.

"Esta tecnología emergente requiere grandes conjuntos de datos para entrenar. Dado que muchos equipos de desarrollo necesitan manipular cantidades masivas de datos, compartirlos con sus pares o colaborar en proyectos públicos de código abierto, casos como el de Microsoft son cada vez más difíciles de monitorear y evitar".

BleepingComputer también informó hace un año que, en septiembre de 2022, la empresa de inteligencia sobre amenazas SOCRadar detectó otro depósito de Azure Blob Storage mal configurado perteneciente a Microsoft, que contenía datos confidenciales almacenados en archivos con fecha de 2017 a agosto de 2022 y vinculados a más de 65.000 entidades de 111 países.

SOCRadar también creó un portal de búsqueda de fugas de datos llamado BlueBleed que permite a las empresas averiguar si sus datos confidenciales estuvieron expuestos en línea. Microsoft añadió más tarde que creía que SOCRadar "exageró enormemente el alcance de este problema" y "los números".

Fuente: BC